Nvidia hat BlueField-4 STX vorgestellt, eine neue Referenzarchitektur, die eine kritische Leistungsbeschränkung in der künstlichen Intelligenz beheben soll: die Geschwindigkeit, mit der KI-Agenten auf Daten zugreifen und diese verarbeiten können. Das Kernproblem sind nicht die KI-Modelle selbst, sondern die Unfähigkeit traditioneller Speichersysteme, mit den Anforderungen moderner Inferenz Schritt zu halten. Dieser Engpass beeinträchtigt die Fähigkeit der KI, bei komplexen Aufgaben, Toolaufrufen und mehrstufigen Argumentationsprozessen ein kohärentes „Arbeitsgedächtnis“ aufrechtzuerhalten.

Das Problem mit dem aktuellen Speicher

Große Sprachmodelle (LLMs) stützen sich auf einen Schlüsselwert-Cache (KV), um Zwischenberechnungen zu speichern, sodass sie die wiederholte Neuberechnung derselben Informationen vermeiden können. Da KI-Agenten längere Kontexte und komplexere Aufgaben bewältigen, wächst dieser Cache exponentiell. Wenn dieser Cache auf langsamen, herkömmlichen Speicher zugreifen muss, sinken die Inferenzgeschwindigkeiten und die GPU-Auslastung leidet. Dies ist kein theoretisches Problem: Die KI-Leistung wird direkt dadurch begrenzt, wie schnell sie zuvor verarbeitete Daten abrufen kann.

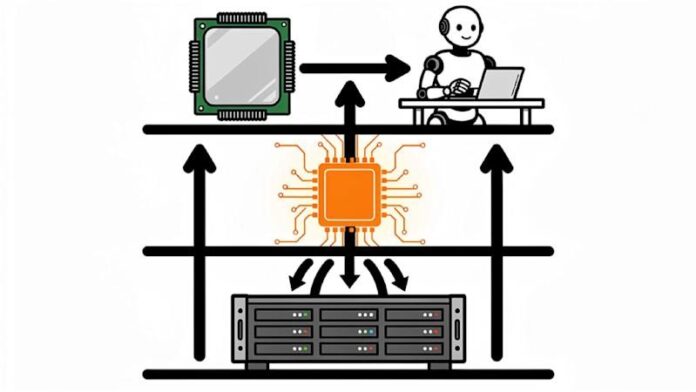

BlueField-4 STX: Eine Kontextspeicherschicht

Nvidias Lösung ist kein Produkt, das sie direkt verkaufen, sondern ein Referenzdesign für Speicherpartner. BlueField-4 STX fügt eine dedizierte „Kontextspeicherschicht“ zwischen GPUs und herkömmlichem Speicher ein. Die Architektur kombiniert die Vera-CPU von Nvidia mit der ConnectX-9 SuperNIC, läuft auf dem Spectrum-X-Ethernet-Netzwerk und ist über die DOCA-Softwareplattform von Nvidia programmierbar. Das Ziel ist einfach: Halten Sie den KV-Cache mit Geschwindigkeiten zugänglich, die der GPU-Verarbeitung entsprechen. Die erste Implementierung ist die CMX-Kontextspeicher-Speicherplattform, die den GPU-Speicher um eine Hochleistungsschicht zum Speichern und Abrufen von KV-Cache-Daten erweitert.

Partner-Ökosystem und Verfügbarkeit

Nvidia verteilt diese Referenzarchitektur an seine Speicherpartner, um eine KI-native Infrastruktur aufzubauen. Das Unternehmen hat Zusagen von wichtigen Akteuren erhalten, darunter Cloudian, Dell Technologies, HPE, IBM, NetApp, VAST Data und WEKA. Cloud-Anbieter wie CoreWeave, Mistral AI und Oracle Cloud Infrastructure haben sich ebenfalls zur Einführung von STX für die Kontextspeicherspeicherung verpflichtet.

Es wird erwartet, dass auf STX basierende Plattformen in der zweiten Hälfte des Jahres 2026 von Partnern verfügbar sein werden. Die Kombination aus etablierten Enterprise-Storage-Anbietern und KI-nativen Cloud-Anbietern signalisiert die Absicht von Nvidia, STX als neuen Standard für KI-Infrastruktur zu positionieren.

Leistungssteigerungen in der Praxis

IBM demonstriert bereits die Wirkung dieses Ansatzes. Ihr Storage Scale System 6000, zertifiziert auf Nvidia DGX-Plattformen, hat erhebliche Verbesserungen bei den Datenaktualisierungszyklen für strukturierte Analyse-Workloads gezeigt. In einem Proof-of-Concept mit Nestlé konnte eine Datenaktualisierung in 186 Ländern und 44 Tabellen von 15 Minuten auf nur drei Minuten verkürzt werden, was zu 83 % Kosteneinsparungen und einer 30-fachen Preis-Leistungs-Verbesserung führte. Dieses Beispiel konzentriert sich zwar auf strukturierte Daten, verdeutlicht aber den umfassenderen Punkt: Die Speicherschicht ist oft die Hauptbeschränkung bei KI-Implementierungen in Unternehmen.

Warum das wichtig ist

Die Umstellung auf kontextoptimierten Speicher ist von entscheidender Bedeutung, da Allzweckspeicher nicht für die Latenzanforderungen von Agenten-KI-Workloads ausgelegt ist. Da KI immer stärker in Unternehmensabläufe integriert wird, wird die Speicherschicht zu einer erstklassigen Infrastrukturentscheidung und nicht zu einem nachträglichen Gedanken bei der GPU-Beschaffung. Nvidia gibt an, dass STX im Vergleich zu herkömmlichem CPU-basiertem Speicher einen fünffachen Token-Durchsatz, eine vierfache Energieeffizienz und eine zweifache Datenaufnahmegeschwindigkeit bietet, obwohl spezifische Basiskonfigurationen für diese Messungen noch nicht spezifiziert sind.

Zusammenfassend lässt sich sagen, dass Nvidias BlueField-4 STX eine grundlegende Veränderung in der Herangehensweise von Unternehmen an die KI-Infrastruktur darstellt. Durch die Beseitigung des Speicherengpasses ebnet das Unternehmen den Weg für schnellere, effizientere und skalierbarere KI-Implementierungen in einer Vielzahl von Branchen.