Nvidia ha presentado BlueField-4 STX, una nueva arquitectura de referencia diseñada para abordar una limitación crítica de rendimiento en inteligencia artificial: la velocidad a la que los agentes de IA pueden acceder y procesar datos. El problema central no son los modelos de IA en sí, sino la incapacidad de los sistemas de almacenamiento tradicionales para seguir el ritmo de las demandas de la inferencia moderna. Este cuello de botella afecta la capacidad de la IA para mantener una “memoria de trabajo” coherente durante tareas complejas, llamadas a herramientas y procesos de razonamiento de varios pasos.

El problema con el almacenamiento actual

Los modelos de lenguajes grandes (LLM) se basan en una caché de valores clave (KV) para almacenar cálculos intermedios, lo que les permite evitar volver a calcular la misma información repetidamente. A medida que los agentes de IA manejan contextos más largos y tareas más complejas, este caché crece exponencialmente. Cuando ese caché debe acceder a un almacenamiento tradicional lento, las velocidades de inferencia disminuyen y la utilización de la GPU se ve afectada. Este no es un problema teórico: el rendimiento de la IA está directamente limitado por la rapidez con la que puede recuperar datos procesados previamente.

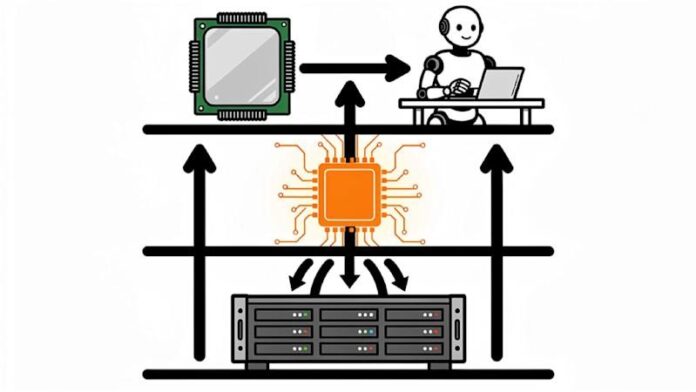

BlueField-4 STX: una capa de memoria contextual

La solución de Nvidia no es un producto que venden directamente, sino un diseño de referencia para los socios de almacenamiento. BlueField-4 STX inserta una “capa de memoria contextual” dedicada entre las GPU y el almacenamiento convencional. La arquitectura combina la CPU Vera de Nvidia con ConnectX-9 SuperNIC, que se ejecuta en una red Ethernet Spectrum-X y es programable a través de la plataforma de software DOCA de Nvidia. El objetivo es simple: mantener accesible la caché KV a velocidades que coincidan con el procesamiento de la GPU. La primera implementación es la plataforma de almacenamiento de memoria contextual CMX, que amplía la memoria de la GPU con una capa de alto rendimiento para almacenar y recuperar datos de caché KV.

Ecosistema de socios y disponibilidad

Nvidia está distribuyendo esta arquitectura de referencia a sus socios de almacenamiento para construir una infraestructura nativa de IA. La empresa ha conseguido compromisos de importantes actores, incluidos Cloudian, Dell Technologies, HPE, IBM, NetApp, VAST Data y WEKA. Proveedores de nube como CoreWeave, Mistral AI y Oracle Cloud Infrastructure también se han comprometido a adoptar STX para el almacenamiento de memoria contextual.

Se espera que las plataformas basadas en STX estén disponibles para los socios en la segunda mitad de 2026. La combinación de los titulares de almacenamiento empresarial y los proveedores de nube nativos de IA señala la intención de Nvidia de posicionar STX como un nuevo estándar para la infraestructura de IA.

Mejoras de rendimiento en el mundo real

IBM ya está demostrando el impacto de este enfoque. Su Storage Scale System 6000, certificado en plataformas Nvidia DGX, ha mostrado mejoras significativas en los ciclos de actualización de datos para cargas de trabajo de análisis estructurados. En una prueba de concepto con Nestlé, una actualización de datos en 186 países y 44 tablas se redujo de 15 minutos a solo tres minutos, lo que generó un ahorro de costos del 83% y una mejora de precio-rendimiento 30 veces mayor. Si bien este ejemplo se centra en datos estructurados, ilustra el punto más amplio: la capa de almacenamiento es a menudo la principal limitación en las implementaciones de IA empresarial.

Por qué esto es importante

El cambio hacia el almacenamiento optimizado para el contexto es fundamental porque el almacenamiento de uso general no fue diseñado para los requisitos de latencia de las cargas de trabajo de IA agente. A medida que la IA se integre más en las operaciones empresariales, la capa de almacenamiento se convertirá en una decisión de infraestructura de primera clase, no en una ocurrencia tardía en la adquisición de GPU. Nvidia afirma que STX ofrece un rendimiento de token 5 veces mayor, una eficiencia energética 4 veces mayor y una velocidad de ingestión de datos 2 veces mayor en comparación con el almacenamiento tradicional basado en CPU, aunque las configuraciones de referencia específicas para estas mediciones siguen sin especificarse.

En conclusión, BlueField-4 STX de Nvidia representa un cambio fundamental en la forma en que las empresas abordan la infraestructura de IA. Al abordar el cuello de botella del almacenamiento, la empresa está allanando el camino para implementaciones de IA más rápidas, eficientes y escalables en una amplia gama de industrias.