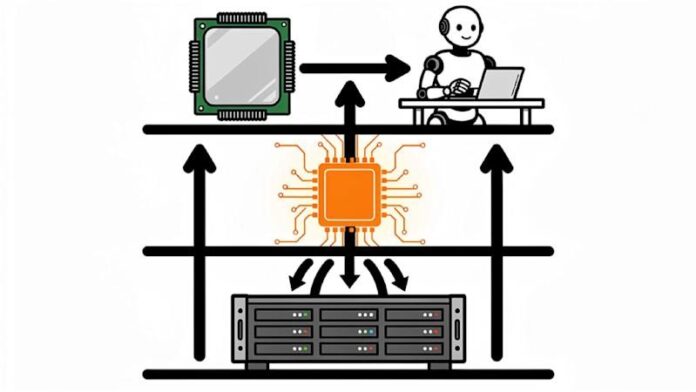

Nvidia a dévoilé BlueField-4 STX, une nouvelle architecture de référence conçue pour répondre à une limitation critique des performances de l’intelligence artificielle : la vitesse à laquelle les agents d’IA peuvent accéder et traiter les données. Le problème principal ne réside pas dans les modèles d’IA eux-mêmes, mais dans l’incapacité des systèmes de stockage traditionnels à suivre le rythme des exigences de l’inférence moderne. Ce goulot d’étranglement a un impact sur la capacité de l’IA à maintenir une « mémoire de travail » cohérente lors de tâches complexes, d’appels d’outils et de processus de raisonnement en plusieurs étapes.

Le problème avec le stockage actuel

Les grands modèles de langage (LLM) s’appuient sur un cache clé-valeur (KV) pour stocker les calculs intermédiaires, ce qui leur permet d’éviter de recalculer les mêmes informations à plusieurs reprises. À mesure que les agents IA gèrent des contextes plus longs et des tâches plus complexes, ce cache augmente de façon exponentielle. Lorsque ce cache doit accéder à un stockage lent et traditionnel, les vitesses d’inférence diminuent et l’utilisation du GPU en souffre. Il ne s’agit pas d’un problème théorique : les performances de l’IA sont directement limitées par la rapidité avec laquelle elle peut récupérer les données précédemment traitées.

BlueField-4 STX : une couche de mémoire contextuelle

La solution de Nvidia n’est pas un produit qu’ils vendent directement, mais une conception de référence pour les partenaires de stockage. BlueField-4 STX insère une « couche de mémoire contextuelle » dédiée entre les GPU et le stockage conventionnel. L’architecture combine le processeur Vera de Nvidia avec le SuperNIC ConnectX-9, fonctionnant sur le réseau Ethernet Spectrum-X et programmable via la plate-forme logicielle DOCA de Nvidia. L’objectif est simple : garder le cache KV accessible à des vitesses qui correspondent au traitement GPU. La première implémentation est la plate-forme de stockage de mémoire contextuelle CMX, qui étend la mémoire GPU avec une couche hautes performances pour stocker et récupérer les données du cache KV.

Écosystème et disponibilité des partenaires

Nvidia distribue cette architecture de référence à ses partenaires de stockage pour construire une infrastructure native d’IA. La société a obtenu des engagements d’acteurs majeurs, notamment Cloudian, Dell Technologies, HPE, IBM, NetApp, VAST Data et WEKA. Les fournisseurs de cloud tels que CoreWeave, Mistral AI et Oracle Cloud Infrastructure se sont également engagés à adopter STX pour le stockage en mémoire contextuelle.

Les plates-formes basées sur STX devraient être disponibles auprès des partenaires au cours du second semestre 2026. La combinaison d’opérateurs historiques de stockage d’entreprise et de fournisseurs de cloud natif d’IA signale l’intention de Nvidia de positionner STX comme une nouvelle norme pour l’infrastructure d’IA.

Gains de performances réels

IBM démontre déjà l’impact de cette approche. Leur Storage Scale System 6000, certifié sur les plates-formes Nvidia DGX, a montré des améliorations significatives dans les cycles de rafraîchissement des données pour les charges de travail d’analyse structurées. Dans le cadre d’une validation de principe avec Nestlé, l’actualisation des données dans 186 pays et 44 tables est passée de 15 minutes à seulement trois minutes, ce qui a permis de réaliser des économies de coûts de 83 % et une amélioration du rapport qualité/prix de 30 fois. Bien que cet exemple se concentre sur les données structurées, il illustre le point plus large : la couche de stockage est souvent la principale contrainte dans les déploiements d’IA en entreprise.

Pourquoi c’est important

La transition vers un stockage optimisé en fonction du contexte est essentielle, car le stockage à usage général n’a pas été conçu pour répondre aux exigences de latence des charges de travail d’IA agentique. À mesure que l’IA s’intègre davantage aux opérations de l’entreprise, la couche de stockage deviendra une décision d’infrastructure de premier ordre, et non une réflexion après coup sur l’achat de GPU. Nvidia affirme que STX offre un débit de jetons 5x, une efficacité énergétique 4x et une vitesse d’ingestion de données 2x par rapport au stockage traditionnel basé sur CPU, bien que les configurations de base spécifiques pour ces mesures restent non spécifiées.

En conclusion, le BlueField-4 STX de Nvidia représente un changement fondamental dans la façon dont les entreprises abordent l’infrastructure de l’IA. En s’attaquant au goulot d’étranglement du stockage, l’entreprise ouvre la voie à des déploiements d’IA plus rapides, plus efficaces et plus évolutifs dans un large éventail de secteurs.