Nvidia ha presentato BlueField-4 STX, una nuova architettura di riferimento progettata per affrontare un limite critico delle prestazioni nell’intelligenza artificiale: la velocità con cui gli agenti AI possono accedere ed elaborare i dati. Il problema principale non sono i modelli di intelligenza artificiale in sé, ma l’incapacità dei sistemi di storage tradizionali di tenere il passo con le esigenze dell’inferenza moderna. Questo collo di bottiglia influisce sulla capacità dell’intelligenza artificiale di mantenere una “memoria di lavoro” coerente durante attività complesse, chiamate di strumenti e processi di ragionamento in più fasi.

Il problema con lo spazio di archiviazione attuale

I modelli linguistici di grandi dimensioni (LLM) si basano su una cache di valori-chiave (KV) per archiviare i calcoli intermedi, consentendo loro di evitare di ricalcolare ripetutamente le stesse informazioni. Poiché gli agenti AI gestiscono contesti più lunghi e attività più complesse, questa cache cresce in modo esponenziale. Quando la cache deve accedere a uno storage tradizionale e lento, la velocità di inferenza diminuisce e l’utilizzo della GPU ne risente. Questo non è un problema teorico: le prestazioni dell’intelligenza artificiale sono direttamente limitate dalla velocità con cui riesce a recuperare i dati elaborati in precedenza.

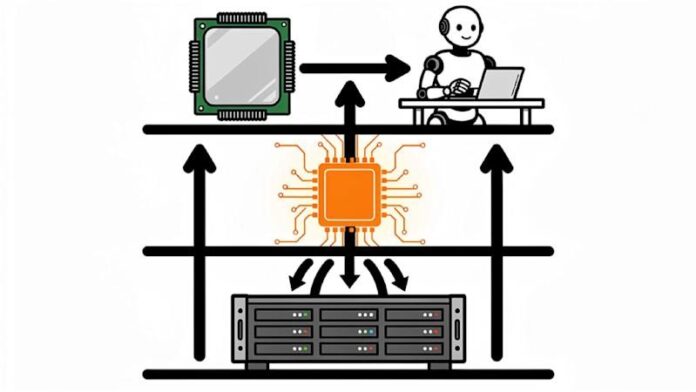

BlueField-4 STX: uno strato di memoria di contesto

La soluzione di Nvidia non è un prodotto venduto direttamente, ma un progetto di riferimento per i partner di storage. BlueField-4 STX inserisce un “livello di memoria di contesto” dedicato tra le GPU e lo storage convenzionale. L’architettura combina la CPU Vera di Nvidia con ConnectX-9 SuperNIC, in esecuzione su rete Ethernet Spectrum-X e programmabile tramite la piattaforma software DOCA di Nvidia. L’obiettivo è semplice: mantenere la cache KV accessibile a velocità che corrispondono all’elaborazione della GPU. La prima implementazione è la piattaforma di storage della memoria di contesto CMX, che estende la memoria della GPU con un livello ad alte prestazioni per l’archiviazione e il recupero dei dati della cache KV.

Ecosistema e disponibilità dei partner

Nvidia sta distribuendo questa architettura di riferimento ai suoi partner di storage per costruire un’infrastruttura nativa per l’intelligenza artificiale. L’azienda ha ottenuto impegni da parte di importanti attori tra cui Cloudian, Dell Technologies, HPE, IBM, NetApp, VAST Data e WEKA. Anche i fornitori di servizi cloud come CoreWeave, Mistral AI e Oracle Cloud Infrastructure si sono impegnati ad adottare STX per l’archiviazione della memoria di contesto.

Si prevede che le piattaforme basate su STX saranno disponibili presso i partner nella seconda metà del 2026. La combinazione di operatori storici dello storage aziendale e fornitori di cloud nativi per l’intelligenza artificiale segnala l’intenzione di Nvidia di posizionare STX come un nuovo standard per l’infrastruttura AI.

Miglioramenti delle prestazioni nel mondo reale

IBM sta già dimostrando l’impatto di questo approccio. Il loro Storage Scale System 6000, certificato sulle piattaforme Nvidia DGX, ha mostrato miglioramenti significativi nei cicli di aggiornamento dei dati per carichi di lavoro di analisi strutturate. In una prova di concetto con Nestlé, un aggiornamento dei dati in 186 paesi e 44 tabelle è sceso da 15 minuti a soli tre minuti, ottenendo un risparmio sui costi dell’83% e un miglioramento del rapporto prezzo-prestazioni di 30 volte. Sebbene questo esempio si concentri sui dati strutturati, illustra il punto più ampio: il livello di archiviazione è spesso il vincolo principale nelle implementazioni di intelligenza artificiale aziendale.

Perché è importante

Il passaggio allo storage ottimizzato per il contesto è fondamentale perché lo storage per scopi generici non è stato progettato per i requisiti di latenza dei carichi di lavoro di intelligenza artificiale con agenti. Man mano che l’intelligenza artificiale diventa sempre più integrata nelle operazioni aziendali, il livello di storage diventerà una decisione infrastrutturale di prima classe, non un ripensamento per l’approvvigionamento di GPU. Nvidia afferma che STX offre un throughput dei token 5 volte superiore, un’efficienza energetica 4 volte superiore e una velocità di acquisizione dei dati 2 volte superiore rispetto allo storage tradizionale basato su CPU, sebbene le configurazioni di base specifiche per queste misurazioni rimangano non specificate.

In conclusione, BlueField-4 STX di Nvidia rappresenta un cambiamento fondamentale nel modo in cui le aziende affrontano l’infrastruttura AI. Risolvendo il collo di bottiglia dello storage, l’azienda sta aprendo la strada a implementazioni di intelligenza artificiale più veloci, più efficienti e più scalabili in un’ampia gamma di settori.