Nvidia wprowadziła BlueField-4 STX, nową architekturę referencyjną zaprojektowaną w celu rozwiązania krytycznego ograniczenia wydajności sztucznej inteligencji: szybkości, z jaką agenci AI mogą uzyskać dostęp do danych i je przetwarzać. Głównym problemem nie są same modele sztucznej inteligencji, ale niezdolność tradycyjnych systemów pamięci masowej do sprostania wymaganiom współczesnych komputerów. To wąskie gardło utrudnia sztucznej inteligencji utrzymanie spójnej „pamięci roboczej” podczas złożonych zadań, wywołań narzędzi i wieloetapowych procesów wnioskowania.

Problem z istniejącymi repozytoriami

Modele wielkojęzykowe (LLM) opierają się na pamięciach podręcznych typu klucz-wartość (KV) do przechowywania obliczeń pośrednich, co pozwala uniknąć wielokrotnego obliczania tych samych informacji. W miarę jak agenci AI przetwarzają dłuższe konteksty i złożone zadania, pamięć podręczna rośnie wykładniczo. Kiedy ta pamięć podręczna musi uzyskać dostęp do powolnej, tradycyjnej pamięci, prędkość obliczeń spada i zmniejsza się wykorzystanie procesora graficznego (GPU). Nie jest to problem teoretyczny: wydajność sztucznej inteligencji jest bezpośrednio ograniczona szybkością, z jaką może ona pobierać wcześniej przetworzone dane.

BlueField-4 STX: Warstwa pamięci kontekstowej

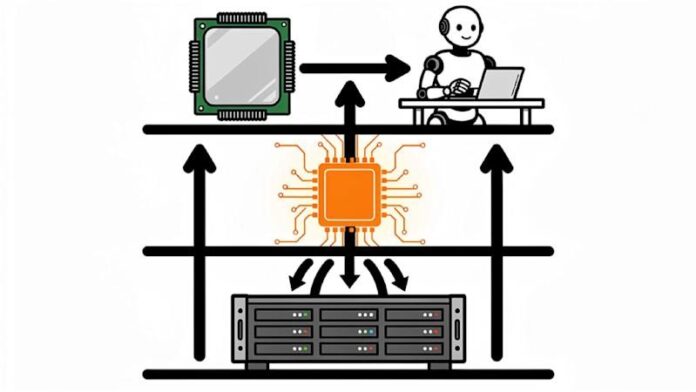

Rozwiązanie Nvidii nie jest produktem, który sprzedaje bezpośrednio, ale projektem referencyjnym dla partnerów zajmujących się pamięcią masową. BlueField-4 STX wstawia dedykowaną „warstwę pamięci kontekstowej” pomiędzy procesorami graficznymi a konwencjonalną pamięcią masową. Architektura łączy procesor Nvidia Vera z kartą supersieci ConnectX-9 działającą w sieci Spectrum-X Ethernet i programowalną przy użyciu platformy oprogramowania DOCA firmy Nvidia. Cel jest prosty: zapewnić dostępność pamięci podręcznej KV przy prędkościach odpowiadających przetwarzaniu procesora graficznego. Pierwszą implementacją jest platforma przechowywania pamięci kontekstowej CMX, która rozszerza pamięć GPU o warstwę o wysokiej wydajności do przechowywania i odzyskiwania danych z pamięci podręcznej KV.

Ekosystem partnerów i dostępność

Nvidia dystrybuuje tę architekturę referencyjną wśród swoich partnerów zajmujących się pamięcią masową, aby stworzyć infrastrukturę zoptymalizowaną pod kątem sztucznej inteligencji. Firma otrzymała zobowiązania od głównych graczy, w tym Cloudian, Dell Technologies, HPE, IBM, NetApp, VAST Data i WEKA. Dostawcy usług w chmurze, tacy jak CoreWeave, Mistral AI i Oracle Cloud Infrastructure, również zobowiązali się do wdrożenia STX do przechowywania pamięci kontekstowej.

Platform opartych na STX oczekuje się od partnerów w drugiej połowie 2026 r. Połączenie uznanych dostawców pamięci masowych dla przedsiębiorstw i dostawców usług chmurowych zorientowanych na sztuczną inteligencję sygnalizuje zamiar Nvidii pozycjonowania STX jako nowego standardu dla infrastruktury AI.

Prawdziwe korzyści w zakresie produktywności

IBM już demonstruje wpływ tego podejścia. Ich system Storage Scale System 6000, certyfikowany na platformach Nvidia DGX, wykazał znaczną poprawę cykli odświeżania danych w przypadku obciążeń związanych z analityką strukturalną. W pilotażu przeprowadzonym z Nestlé aktualizacja danych w 186 krajach i 44 tabelach została skrócona z 15 minut do zaledwie trzech, co przełożyło się na 83% oszczędności i 30-krotny wzrost ceny do wydajności. Chociaż ten przykład skupia się na danych strukturalnych, ilustruje szerszy punkt: warstwa przechowywania danych jest często głównym ograniczeniem we wdrożeniach sztucznej inteligencji w przedsiębiorstwach.

Dlaczego to jest ważne?

Przejście na pamięć masową zoptymalizowaną kontekstowo ma kluczowe znaczenie, ponieważ uniwersalna pamięć masowa nie została zaprojektowana z myślą o wymaganiach dotyczących opóźnień obciążeń AI opartych na agentach. W miarę integracji sztucznej inteligencji z operacjami przedsiębiorstwa warstwa pamięci masowej stanie się kluczowym rozwiązaniem infrastrukturalnym, a nie dodatkiem do zakupów GPU. Nvidia twierdzi, że STX zapewnia 5x przepustowość tokena, 4x większą efektywność energetyczną i 2x prędkość ładowania danych w porównaniu z tradycyjną pamięcią masową opartą na procesorze, chociaż szczegółowe konfiguracje początkowe dla tych pomiarów pozostają nieokreślone.

Podsumowując, BlueField-4 STX firmy Nvidia stanowi zasadniczą zmianę w podejściu przedsiębiorstw do infrastruktury sztucznej inteligencji. Eliminując wąskie gardło w zakresie pamięci masowej, firma toruje drogę do szybszych, bardziej wydajnych i skalowalnych wdrożeń sztucznej inteligencji w wielu branżach.