Sieci społecznościowe, niegdyś zaprojektowane jako narzędzia komunikacji, są coraz częściej przechwytywane przez sztuczne treści, pozostawiając użytkowników z poczuciem rozłączenia i izolacji. Rozpowszechnianie się filmów, obrazów i deepfake’ów generowanych przez sztuczną inteligencję radykalnie zmienia doświadczenia online, budząc obawy co do zaufania, autentyczności i przyszłości interakcji międzyludzkich.

Powstanie „śmieci AI”

Pojawienie się generatywnych narzędzi AI, takich jak Sora firmy OpenAI, Veo firmy Google i Midjourney, sprawiło, że tworzenie przekonująco realistycznych, ale całkowicie sfabrykowanych treści stało się niezwykle łatwe. Zjawisko to, zwane „śmieciami AI”, odnosi się do masowego napływu niskiej jakości, często bezsensownych materiałów cyfrowych, zalewających kanały informacyjne. Od zwierząt demonstrujących ludzkie zachowanie po niemożliwe dowcipy – te filmy mają za zadanie szokować, bawić lub oszukiwać.

Deepfakes jeszcze bardziej pogłębiają problem, tworząc realistyczne, ale fałszywe obrazy osób publicznych. Nie chodzi tylko o rozrywkę; chodzi o zniszczenie zaufania do mediów wizualnych i o to, że coraz trudniej jest odróżnić fakty od fikcji.

To ważne, ponieważ sam fundament mediów społecznościowych – wspólne doświadczenia – załamuje się pod ciężarem sztuczności. Niekończący się strumień syntetycznych treści jest wyczerpujący i sprawia, że użytkownikom coraz trudniej jest zrozumieć, co jest prawdziwe.

Biznes sztuczności

Firmy technologiczne są zainteresowane zwiększaniem możliwości sztucznej inteligencji, nawet kosztem pogorszenia doświadczenia użytkownika. Jak wskazuje Alexios Mantzarlis, dyrektor Inicjatywy na rzecz Bezpieczeństwa, Zaufania i Bezpieczeństwa firmy Cornell Tech, platformy te przedkładają podnoszenie cen akcji nad prawdziwą komunikację.

Nacisk na zaangażowanie oparte na sztucznej inteligencji jest szczególnie zauważalny na platformach takich jak TikTok, gdzie algorytmy przedkładają uzależniające treści nad znaczące interakcje. Chociaż użytkownicy mogą czerpać przyjemność z odkrywania nowych tematów, rezultatem często jest poczucie odłączenia się od prawdziwych relacji.

Ta zmiana nie jest przypadkowa. Firmy technologiczne wykorzystują sztuczną inteligencję, aby zmaksymalizować uwagę użytkowników, nawet jeśli oznacza to poświęcenie autentyczności.

Zniszczenie autentyczności

Przed sztuczną inteligencją media społecznościowe już zmagały się z nierealistycznymi standardami i fikcyjnymi osobowościami. Teraz problem pogłębia możliwość stworzenia całkowicie sztucznej rzeczywistości. Użytkownicy nie tylko porównują się do nieosiągalnych ideałów, ale także kwestionują ważność wszystkiego, co widzą w Internecie.

„Kiedyś mieliśmy problem z nierealistycznymi oczekiwaniami wobec ciała” – powiedziała Mantzarlis. „A teraz mamy do czynienia ze światem nierealistycznych oczekiwań wobec ciała”.

Brak zaufania do treści generowanych przez sztuczną inteligencję jest już wysoki. Badanie Raptive wykazało, że prawie połowa respondentów instynktownie nie ufa treściom, które według nich zostały stworzone przez sztuczną inteligencję, a 60% stwierdziło słabszą więź emocjonalną.

Dalsze działania: regulacje i kontrola użytkowników

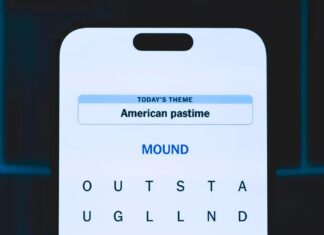

Firmy z branży mediów społecznościowych zaczynają wdrażać takie środki, jak oznaczanie treści generowanych przez sztuczną inteligencję i zakaz szkodliwych deepfakes. Na przykład TikTok testuje mechanizmy kontrolne, które pozwolą użytkownikom ograniczyć kontakt z materiałami generowanymi przez sztuczną inteligencję.

Jednak w przypadku braku solidnych regulacji rządowych, które obecnie są blokowane przez podziały polityczne i lobbing branżowy, ciężar egzekwowania własnych polityk spada na platformy.

Zasadnicze pytanie brzmi, czy te wysiłki będą wystarczające. Szybkie tempo rozwoju sztucznej inteligencji sugeruje, że regulacje nie będą w stanie dotrzymać kroku.

Ostatecznie przyszłość mediów społecznościowych zależy od umiejętności przywrócenia zaufania i autentyczności. Jeśli platformy nie zareagują na zakłócanie rzeczywistości, istnieje ryzyko, że staną się nieistotne, ponieważ użytkownicy wycofują się ze świata, w którym niczemu nie można ufać.