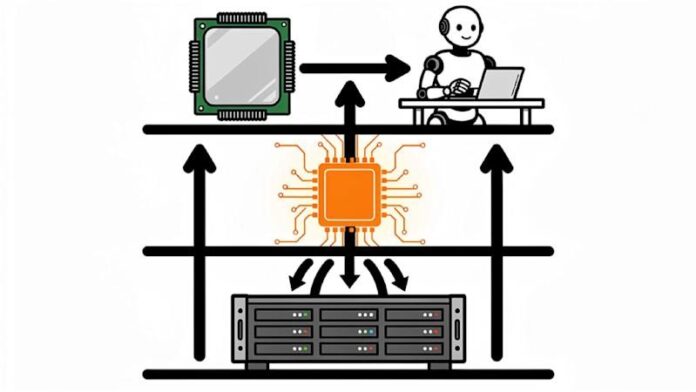

A Nvidia revelou o BlueField-4 STX, uma nova arquitetura de referência projetada para resolver uma limitação crítica de desempenho em inteligência artificial: a velocidade com que os agentes de IA podem acessar e processar dados. O principal problema não são os modelos de IA em si, mas a incapacidade dos sistemas de armazenamento tradicionais de acompanhar as demandas da inferência moderna. Esse gargalo afeta a capacidade da IA de manter uma “memória de trabalho” coerente durante tarefas complexas, chamadas de ferramentas e processos de raciocínio em várias etapas.

O problema com o armazenamento atual

Os modelos de linguagem grande (LLMs) dependem de um cache de valor-chave (KV) para armazenar cálculos intermediários, permitindo evitar o recálculo repetido das mesmas informações. À medida que os agentes de IA lidam com contextos mais longos e tarefas mais complexas, esse cache cresce exponencialmente. Quando esse cache precisa acessar o armazenamento lento e tradicional, a velocidade de inferência cai e a utilização da GPU é prejudicada. Esta não é uma questão teórica: o desempenho da IA é diretamente limitado pela rapidez com que ela pode recuperar dados processados anteriormente.

BlueField-4 STX: uma camada de memória de contexto

A solução da Nvidia não é um produto vendido diretamente, mas um design de referência para parceiros de armazenamento. BlueField-4 STX insere uma “camada de memória de contexto” dedicada entre GPUs e armazenamento convencional. A arquitetura combina a CPU Vera da Nvidia com o ConnectX-9 SuperNIC, rodando em rede Ethernet Spectrum-X e programável por meio da plataforma de software DOCA da Nvidia. O objetivo é simples: manter o cache KV acessível em velocidades que correspondam ao processamento da GPU. A primeira implementação é a plataforma de armazenamento de memória de contexto CMX, que estende a memória da GPU com uma camada de alto desempenho para armazenar e recuperar dados de cache KV.

Ecossistema e disponibilidade de parceiros

A Nvidia está distribuindo esta arquitetura de referência aos seus parceiros de armazenamento para construir infraestrutura nativa de IA. A empresa garantiu compromissos de grandes players, incluindo Cloudian, Dell Technologies, HPE, IBM, NetApp, VAST Data e WEKA. Provedores de nuvem como CoreWeave, Mistral AI e Oracle Cloud Infrastructure também se comprometeram a adotar STX para armazenamento de memória de contexto.

Espera-se que as plataformas baseadas em STX sejam disponibilizadas pelos parceiros no segundo semestre de 2026. A combinação de operadores históricos de armazenamento empresarial e provedores de nuvem nativos de IA sinaliza a intenção da Nvidia de posicionar o STX como um novo padrão para infraestrutura de IA.

Ganhos de desempenho no mundo real

A IBM já está demonstrando o impacto desta abordagem. Seu Storage Scale System 6000, certificado em plataformas Nvidia DGX, mostrou melhorias significativas nos ciclos de atualização de dados para cargas de trabalho de análise estruturada. Numa prova de conceito com a Nestlé, uma atualização de dados em 186 países e 44 tabelas caiu de 15 minutos para apenas três minutos, gerando uma economia de custos de 83% e uma melhoria de 30x no preço-desempenho. Embora este exemplo se concentre em dados estruturados, ele ilustra o ponto mais amplo: a camada de armazenamento é muitas vezes a principal restrição nas implantações de IA empresarial.

Por que isso é importante

A mudança para o armazenamento otimizado para o contexto é crítica porque o armazenamento de uso geral não foi projetado para os requisitos de latência das cargas de trabalho de IA de agente. À medida que a IA se torna mais integrada nas operações empresariais, a camada de armazenamento se tornará uma decisão de infraestrutura de primeira classe, e não uma reflexão tardia na aquisição de GPU. A Nvidia afirma que o STX oferece 5x de rendimento de token, 4x de eficiência energética e 2x de velocidade de ingestão de dados em comparação com o armazenamento tradicional baseado em CPU, embora as configurações de linha de base específicas para essas medições permaneçam não especificadas.

Concluindo, o BlueField-4 STX da Nvidia representa uma mudança fundamental na forma como as empresas abordam a infraestrutura de IA. Ao abordar o gargalo de armazenamento, a empresa está abrindo caminho para implantações de IA mais rápidas, eficientes e escaláveis em uma ampla gama de setores.