Nvidia představila BlueField-4 STX, novou referenční architekturu navrženou tak, aby řešila kritické omezení výkonu v umělé inteligenci: rychlost, jakou mohou agenti umělé inteligence přistupovat k datům a zpracovávat je. Hlavním problémem nejsou samotné modely umělé inteligence, ale neschopnost tradičních úložných systémů držet krok s požadavky moderní výpočetní techniky. Toto úzké místo brání schopnosti umělé inteligence udržet si koherentní „pracovní paměť“ během složitých úkolů, volání nástrojů a vícekrokových procesů uvažování.

Problém se stávajícími repozitáři

Velké jazykové modely (LLM) spoléhají na mezipaměti klíč-hodnota (KV) pro ukládání mezivýpočtů, což jim umožňuje vyhnout se opakovanému počítání stejných informací. Jak agenti AI zpracovávají delší kontexty a složité úkoly, tato mezipaměť roste exponenciálně. Když tato mezipaměť musí přistupovat k pomalému tradičnímu úložišti, výpočetní rychlost klesá a využití grafického procesoru (GPU) klesá. Nejde o teoretický problém: výkon umělé inteligence je přímo omezen rychlostí, s jakou dokáže načíst dříve zpracovaná data.

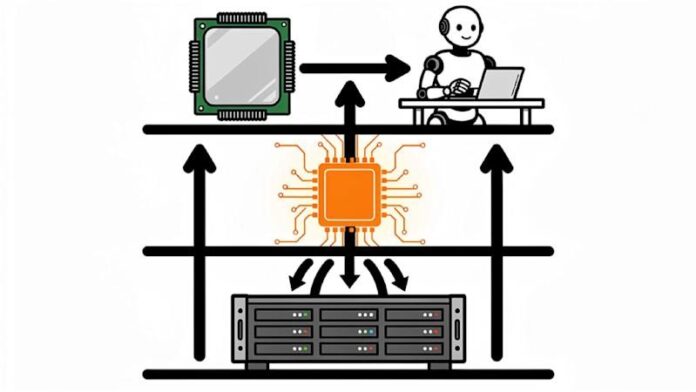

BlueField-4 STX: Kontextová paměťová vrstva

Řešení Nvidie není produkt, který prodávají přímo, ale referenční návrh pro partnery v oblasti úložiště. BlueField-4 STX vkládá vyhrazenou vrstvu „kontextové paměti“ mezi GPU a konvenční úložiště. Architektura kombinuje CPU Nvidia Vera se supernetovou kartou ConnectX-9 běžící na ethernetové síti Spectrum-X a programovatelnou pomocí softwarové platformy Nvidia DOCA. Cíl je jednoduchý: udržovat mezipaměť KV dostupnou při rychlostech, které odpovídají zpracování GPU. První implementací je platforma pro ukládání kontextové paměti CMX, která rozšiřuje paměť GPU o vysoce výkonnou vrstvu pro ukládání a načítání dat KV cache.

Partnerský ekosystém a dostupnost

Nvidia distribuuje tuto referenční architekturu svým partnerům v oblasti úložiště, aby vytvořili infrastrukturu optimalizovanou pro AI. Společnost přijala závazky od hlavních hráčů včetně Cloudian, Dell Technologies, HPE, IBM, NetApp, VAST Data a WEKA. Poskytovatelé cloudu, jako jsou CoreWeave, Mistral AI a Oracle Cloud Infrastructure, se také zavázali implementovat STX pro úložiště kontextové paměti.

Platformy založené na STX se od partnerů očekávají v druhé polovině roku 2026. Kombinace zavedených dodavatelů podnikových úložišť a cloudových poskytovatelů zaměřených na AI signalizuje záměr společnosti Nvidia umístit STX jako nový standard pro infrastrukturu AI.

Skutečné výhody produktivity

IBM již prokazuje dopad tohoto přístupu. Jejich Storage Scale System 6000, certifikovaný na platformách Nvidia DGX, prokázal výrazné zlepšení v cyklech obnovování dat pro úlohy strukturované analýzy. V pilotním projektu s Nestlé byla aktualizace dat ve 186 zemích a 44 tabulkách zkrácena z 15 minut na pouhé tři, což vedlo k 83% úsporám nákladů a 30násobnému nárůstu ceny/výkonu. I když se tento příklad zaměřuje na strukturovaná data, ilustruje širší bod: vrstva úložiště dat je často hlavním omezením při nasazení podnikové umělé inteligence.

Proč je to důležité?

Přechod na kontextově optimalizované úložiště je zásadní, protože univerzální úložiště nebylo navrženo s ohledem na požadavky na latenci pracovních zátěží AI založených na agentech. Vzhledem k tomu, že AI je integrována do podnikových operací, úložná vrstva se stane klíčovým řešením infrastruktury spíše než doplňkem k nákupu GPU. Nvidia říká, že STX poskytuje 5x propustnost tokenů, 4x energetickou účinnost a 2x rychlost načítání dat ve srovnání s tradičním úložištěm založeným na CPU, ačkoli konkrétní počáteční konfigurace pro tato měření zůstávají nespecifikovány.

Na závěr, BlueField-4 STX od Nvidie představuje zásadní změnu v tom, jak podniky přistupují k infrastruktuře AI. Odstraněním úzkého hrdla úložiště společnost připravuje cestu pro rychlejší, efektivnější a škálovatelnější nasazení umělé inteligence v celé řadě průmyslových odvětví.