Un grupo anónimo de usuarios en Discord afirma haber eludido las medidas de seguridad para acceder a Claude Mythos Preview, un modelo de IA inédito y altamente sensible de Anthropic. La brecha es particularmente alarmante debido a las capacidades específicas atribuidas a este modelo.

Lo que está en juego: un modelo diseñado para la guerra cibernética

Anthropic ha categorizado a Claude Mythos como una herramienta potencialmente transformadora de paradigmas con importantes implicaciones de seguridad. Según la empresa, el modelo es capaz de:

– Identificación de vulnerabilidades de día cero (fallas previamente desconocidas) en los principales sistemas operativos.

– Explotar las debilidades de todos los principales navegadores web.

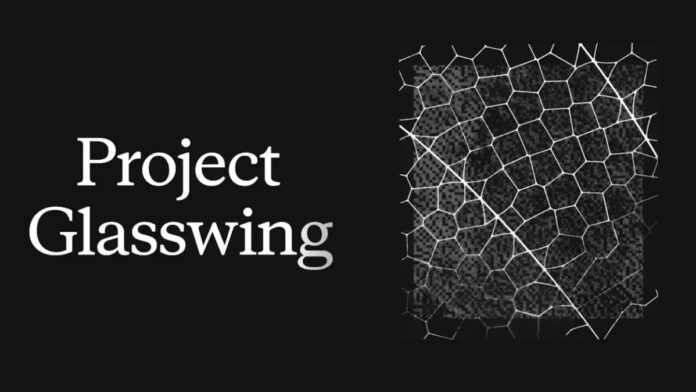

Debido a estas capacidades, Anthropic ha mantenido el modelo bajo estricto candado a través del Proyecto Glasswing. Esta iniciativa solo por invitación fue diseñada para otorgar acceso solo a un grupo selecto de líderes tecnológicos, con el objetivo declarado de utilizar la IA para proteger el software global crítico. Sin embargo, la violación reportada sugiere que la misma herramienta destinada a redefinir la ciberseguridad puede haber sido comprometida por simples errores humanos y de procedimiento.

Cómo ocurrió la infracción: conjeturas y acceso interno

Al contrario de lo que cabría esperar de una infracción que involucrara una IA tan poderosa, la intrusión no fue el resultado de una explotación técnica sofisticada. Más bien, parece haber sido una combinación de reconocimiento de patrones y asistencia interna:

- Reconocimiento de patrones: Utilizando datos de una violación reciente en la startup de IA Mercor, el grupo identificó las convenciones de nomenclatura de Anthropic. Esto les permitió adivinar la ubicación en línea del modelo inédito.

- Acceso interno: Una vez que se identificó la ubicación, el grupo utilizó el acceso privilegiado proporcionado por un miembro que trabajaba para un contratista externo de Anthropic.

El grupo opera dentro de un canal privado de Discord dedicado a buscar información sobre modelos de IA inéditos. Si bien los miembros afirman que están utilizando la herramienta para tareas benignas, como crear sitios web simples, también han afirmado que tienen acceso a modelos antrópicos aún más inéditos.

La situación actual

Anthropic ha confirmado a Bloomberg que está al tanto de las afirmaciones y que actualmente está llevando a cabo una investigación. Si bien el grupo proporcionó pruebas suficientes para fundamentar su acceso, actualmente no hay indicios de que otras partes no autorizadas hayan violado el sistema.

Este incidente pone de relieve una tensión creciente en la industria de la IA: a medida que los modelos se vuelven más capaces de automatizar los ciberataques, los protocolos de seguridad que los protegen deben volverse exponencialmente más sólidos.

Conclusión

El acceso informado a Claude Mythos expone una vulnerabilidad crítica en la forma en que las empresas de inteligencia artificial gestionan modelos altamente sensibles y de alto riesgo. Si se puede acceder a un modelo capaz de remodelar la ciberseguridad mediante simples conjeturas y el acceso de contratistas, surgen preguntas urgentes sobre la seguridad de la próxima generación de inteligencia artificial.